Activité 05 · Administration centralisée

Déploiement de HPE IMC sur le parc institutionnel

Projet d’envergure : étude fonctionnelle et budget, lab Windows Server + MySQL sur licences d’évaluation, intégration SNMPv3 (lecture & écriture), tests & arbitrages avec LibreNMS, résolution de bugs (DOM, dashboards, mémoire), scan sécurité, validation direction, achat des licences via le marché SPIE, production sur Windows Server 2019 + MariaDB et formation des équipes réseau / système.

Étude du logiciel et projection budgétaire

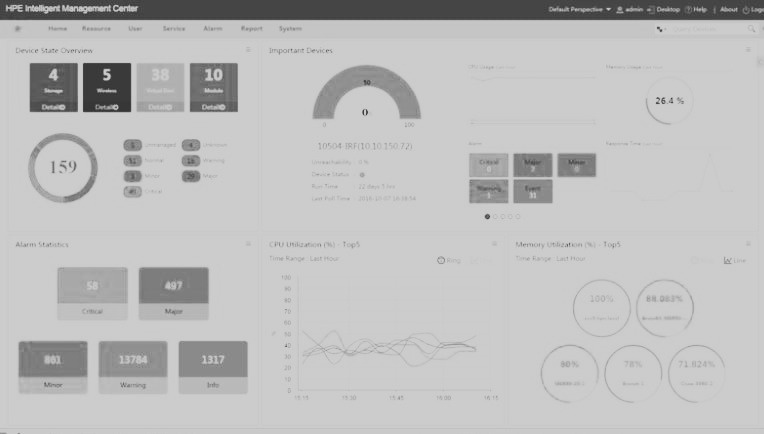

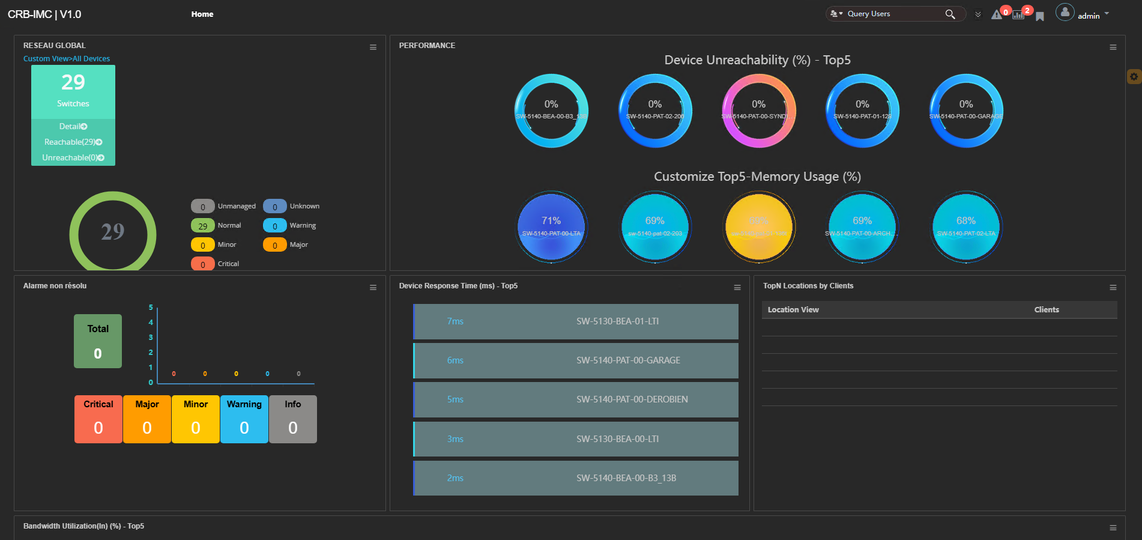

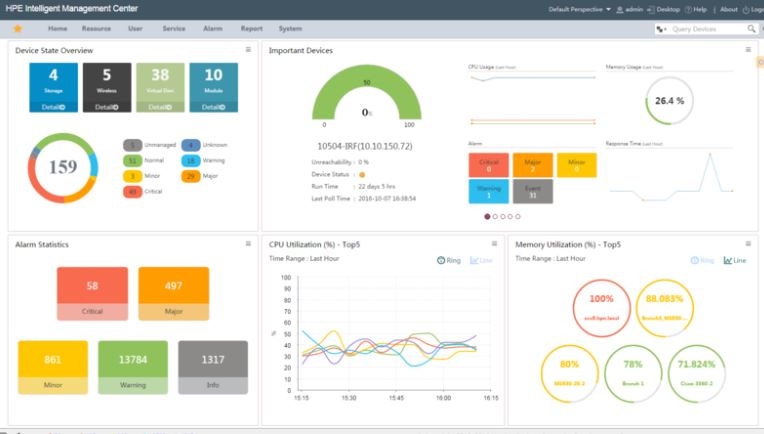

Après le renouvellement du parc HPE, l’équipe Réseau a étudié IMC (Intelligent Management Center) comme levier pour administrer et superviser les nouveaux switchs. Fonctionnalités attendues : découverte automatique, supervision, gestion centralisée des configurations, vision topologique. Sur un parc multi-sites, ces capacités réduisent fortement la dispersion d’outils et de manipulations manuelles.

- ~80 k€budget global indicatif

- ~250licences réseau institutionnel

- ~1 200licences pour les lycées

- 2 sem.délai après commande

En parallèle de l’étude technique, j’ai construit la projection de coût à partir du modèle de licences HPE et du nombre d’équipements à superviser, pour alimenter une proposition budgétaire à la collectivité.

Déploiement en laboratoire

-

Demander la VM auprès de l’infra

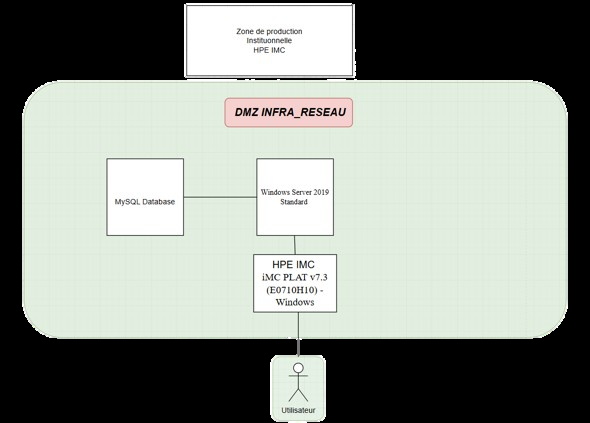

Création d’une machine sous Windows Server, adressage, ouverture des flux vers les switchs à piloter, règles de sécurité. Indispensable pour que le serveur communique avec le matériel réseau.

-

Installer IMC + base MySQL

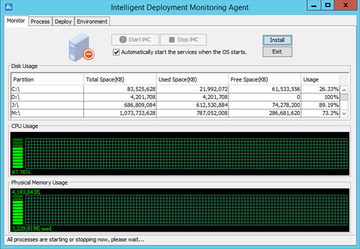

Installation de la plateforme et d’une base MySQL locale, activation des licences d’évaluation HPE (jusqu’à ~50 équipements — suffisant pour simuler une partie du parc).

-

Intégrer la VM au réseau réel

Travailler contre le réseau réel rend les tests beaucoup plus représentatifs qu’une maquette isolée : on observe le comportement vrai vis-à-vis des équipements de production.

-

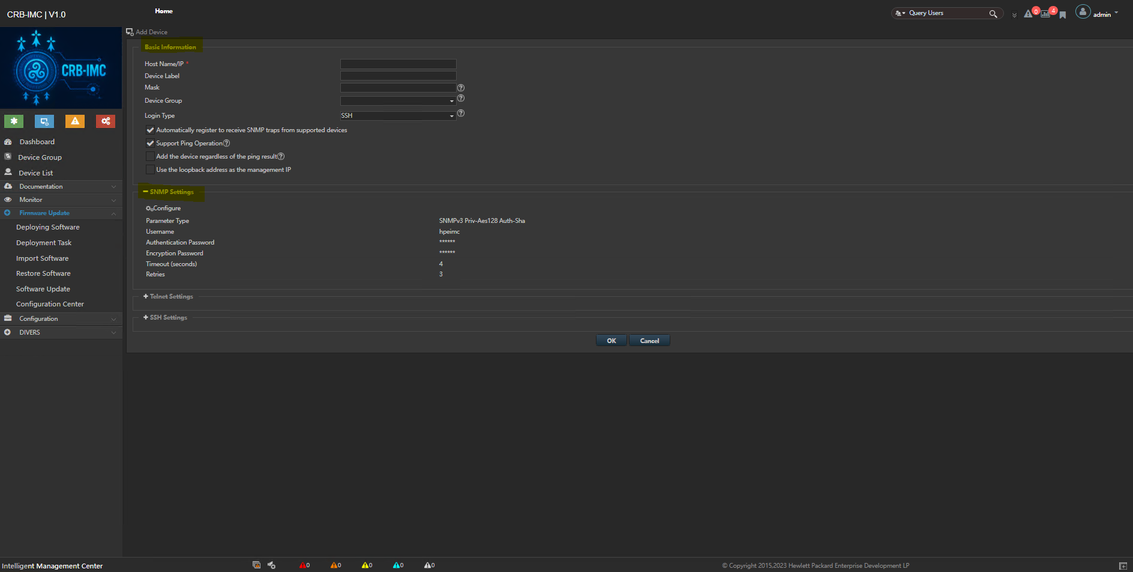

Ajouter les premiers équipements

Ajout pilote de switchs HPE en SNMPv3, observation de la découverte automatique, des cartes topologiques et de la remontée d’interfaces.

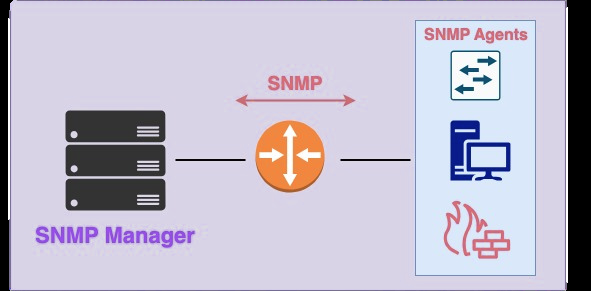

SNMPv3 lecture & écriture

Les équipements ont été intégrés via SNMPv3 : à la fois supervision (interfaces, charge, erreurs…) et — quand la politique de sécurité le valide — action à distance depuis IMC (modifications de configuration, déploiements). Mise en place de profils SNMP distincts pour la lecture et pour l’écriture, afin de séparer monitoring et opérations sensibles.

IMC joue le rôle de gestionnaire SNMP : il interroge les agents embarqués dans les switchs via les MIB. Le contrôle d’accès applicatif définit ensuite qui voit quoi et qui peut pousser des modifications.

Campagne de tests et arbitrage avec LibreNMS

Mesure de la charge CPU/RAM du serveur et de la pertinence des sondes. Plusieurs sondes doublonnaient des indicateurs déjà couverts par LibreNMS : désactivation pour éviter redondance et surcharge.

Décision : orienter IMC vers l’administration centralisée (changements de configuration, mises à jour firmware contrôlées) et conserver LibreNMS comme référence pour une partie du monitoring temps réel.

-

Tester le push de mises à jour firmware

Déploiement contrôlé sur quelques équipements pilotes, vérification post-bascule via interfaces et CLI, validation des bonnes pratiques.

-

Créer et pousser des ACL

Construction d’ACL types depuis IMC, déploiement sur plusieurs switchs en une opération, vérification dans la configuration runtime.

-

Configurer des VLAN en masse

Création / propagation de VLAN sur un groupe de devices, modification rapide des paramètres de ports — gain de temps majeur sur un grand parc.

-

Opérations courantes d’exploitation

Renommage d’équipements, désactivation de ports inutilisés, sauvegarde des configurations centralisées.

Identification et correction de bugs

-

Refus de mise à jour du firmware

Certains modèles refusaient la mise à jour à cause d’une version trop ancienne du sous-système DOM. Mise à niveau manuelle préalable pour les rendre compatibles avec la plateforme.

-

Dashboards non sauvegardés

L’organisation des tableaux de bord ne se persistait pas correctement. Après échange avec le support HPE, correctif appliqué côté base MySQL.

-

Consommation mémoire élevée

Désactivation des modules inutiles dans notre contexte pour réduire l’empreinte mémoire et fluidifier l’interface.

Scan de sécurité complémentaire

Collaboration avec l’équipe sécurité : analyse des ports exposés, des services actifs, des chiffrements et des accès vers le serveur de test.

Présentation à la direction de la DNSI

Une fois les principaux dysfonctionnements corrigés, présentation de l’environnement de test à la direction. Démonstrations sur des actions représentatives :

- Création de VLAN et propagation sur plusieurs switchs en une opération.

- Déploiement d’ACL homogènes sur un groupe d’équipements.

- Modification de paramètres de ports en masse (VLAN access, descriptions).

- Vue topologique, suivi des liens, tableaux de bord.

La direction disposait ainsi d’une vision claire des bénéfices et des limites avant d’engager un budget licence important. À l’issue, le projet a reçu une validation formelle ouvrant la phase d’achat — y compris pour les lycées relevant de la Région.

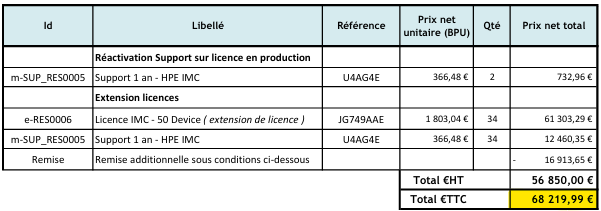

Achat des licences via le marché SPIE

Acquisition des licences dans le cadre du marché existant avec SPIE. Demandes internes via les circuits de la collectivité (achats, marchés publics, BPU) avec transmission des informations précises : volume de licences, périmètre institutionnel vs lycées, modalités de livraison des clés d’activation.

Architecture de production

Après réception des licences, j’ai préparé un dossier technique pour la création des serveurs de production : besoins CPU/RAM/disque, flux réseau, séparation des rôles, conformité aux standards internes.

Go-live et transfert de compétences

-

Vérifier les fonctionnalités essentielles

Découverte des équipements, communication SNMPv3, profils d’écriture pour l’administration, supervision des interfaces et VLAN, tâches automatiques sur la base.

-

Présenter l’outil aux équipes Réseau et Système

Navigation dans les écrans, scénarios courants (VLAN, ACL, ports, push de configuration), bonnes pratiques pour éviter la surcharge serveur et les opérations de masse risquées.

-

Formaliser les usages partagés

Documentation d’exploitation, modèles de tableaux de bord, procédures d’ajout d’équipements, conventions de nommage des actions.

Bilan

Le déploiement d’IMC est l’aboutissement d’un projet de bout en bout : étude et chiffrage, lab sur licences d’évaluation, intégration SNMPv3 avec droits adaptés, batterie de tests et arbitrages avec LibreNMS, chasse aux bugs (firmware/DOM, sauvegardes de dashboards, consommation mémoire), scan de sécurité, présentation direction, achat via le marché SPIE, montée en production sur architecture Windows + MariaDB, puis transfert de compétences.

Ce que j’en retiens

Compétences consolidées

- Pilotage d’un projet technique & organisationnel sur plusieurs mois.

- Articulation entre technique, budget et achats publics.

- Démarche tests → corrections → validation direction → production.

- Réflexe sécurité systématique, y compris en environnement de test.

- Capacité à former une équipe à un nouvel outil.